AI数字人虚拟主播制作sadtalker【人人可复现的教程】

前言

前两期给大家分享了两篇关于数字人的完整制作教程(这里贴出链接,感兴趣的小伙伴可以看下):超写实虚拟数字人再升级【附完整教程】;AI数字人主播技术实现Wav2Lip【附完整版教程】。但是以上两篇对非程序员或者完全不太懂编程的童鞋不是很友好,所以本篇的数字人虚拟主播制作,适用于每一个会电脑的同学,一步一步操作即可,即可直接复现的数字人的制作。以下是效果:

本文主要分为以下三个部分:

第一部分:sadtalker技术介绍

第二部分:sadtalker教程介绍

第三部分:sadtalker完整教程下载

正文

第一部分:sadtalker技术介绍

Wav2lip能够使虚拟人物的口型与输入的语音同步。然而,Wav2lip存在一个问题,即它只能在嘴唇附近实现虚拟人物的动态效果。这两天有饱子已经私信我了,说明大家的行动力很强,所以基于这个问题,今天给大家一个更自然的实现!事实上我们知道,音频与不同面部动作之间的关联是不同的。换句话说,虽然嘴唇的运动与音频之间的联系最为紧密,但头部姿势和眨眼等其他面部表情也可以对音频产生影响。

SadTaker它是通过隐式3D系数调制来驱动风格化音频,生成具有人脸动作的视频。总体而言,SadTaker在面部处理方面的效果优于Wav2Lip,并且相对于Wav2Lip+GFPGAN,速度也有很大提升。此外,SadTaker还支持自由旋转角度,使生成的视频更加自然,前面的视频效果大家已经感受到了。

第二部分:sadtalker教程介绍

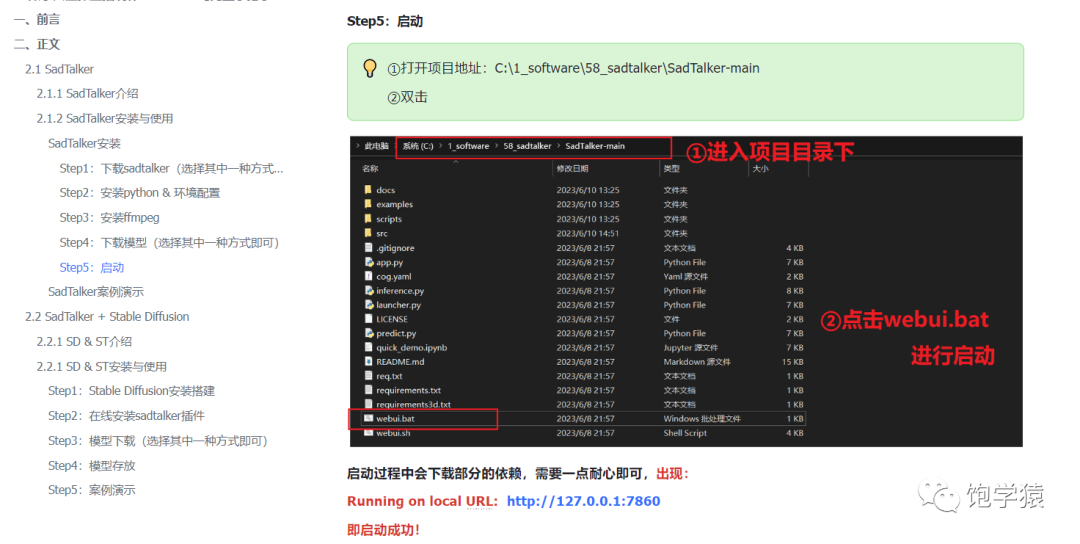

老规矩,完整验证过非常详尽的可复现的教程分享给大家(为了保障文章的结构清晰,仅展示部分截图)

第三部分:sadtalker完整教程下载

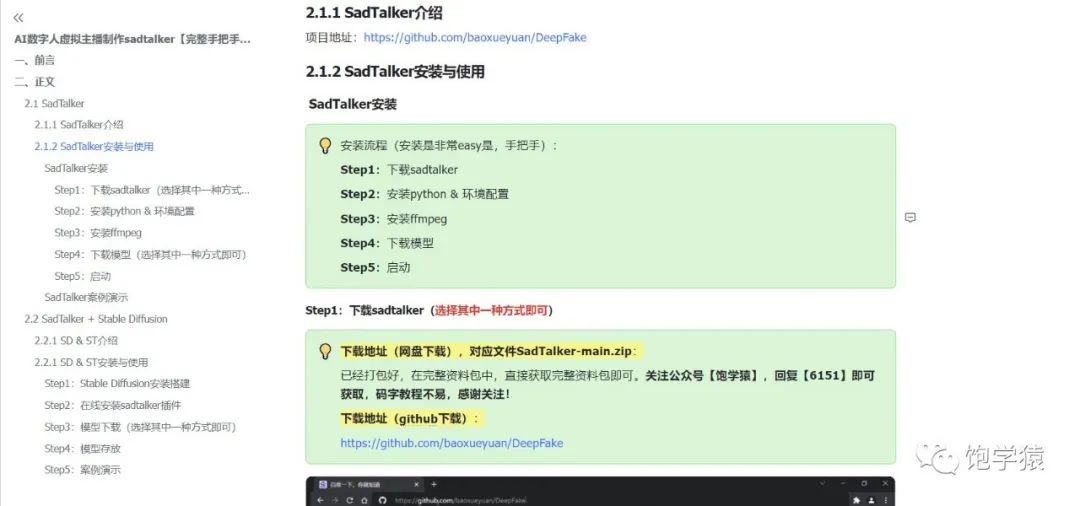

本案例完整教程涉及到软件包、素材、模型文件等完整教程资料包(见下方截图),目前均匀打包上传至百度云 ,大家可自行复现,且均已实测。关注公众号【饱学猿】,回复【6151】即可获取本项目完整可复现资料包,码字教程不易,感谢关注!

今天就分享这些,下期见!